پارادایم نوین امنیت در عصر هوش مصنوعی

فضای دیجیتال امروزی با موجی از حملات سایبری پیچیده و خودکار روبرو است که روشهای سنتی امنیت را به چالش کشیدهاند. سیستمهای امنیتی قدیمی که بر پایه امضا (Signature-based) و قوانین ثابت عمل میکنند، ماهیتی واکنشی دارند و در برابر تهدیدات ناشناخته و حملات روز صفر (Zero-Day) کارایی خود را از دست دادهاند. این رویکردها تنها قادر به شناسایی تهدیداتی هستند که قبلاً دیده شدهاند و در نتیجه، شکاف امنیتی قابل توجهی را به جا میگذارند.

در پاسخ به این چالش، هوش مصنوعی (AI) و زیرشاخههای آن مانند یادگیری ماشین (ML) و یادگیری عمیق (DL) به عنوان یک فناوری تحولآفرین ظهور کردهاند. هوش مصنوعی به سیستمها توانایی یادگیری از دادهها و تطبیق با شرایط جدید را میبخشد و پتانسیل آن را دارد که دفاع سایبری را از حالتی واکنشی به رویکردی پیشبینیکننده و هوشمند تبدیل کند. با این حال، هوش مصنوعی یک شمشیر دو لبه است؛ همانطور که ابزارهای قدرتمندی برای دفاع فراهم میکند، مهاجمان را نیز برای طراحی حملات پیچیدهتر توانمند میسازد. این ماهیت دوگانه، یک “رقابت تسلیحاتی” فناورانه را در فضای سایبری به راه انداخته است که در آن، نبرد از انسان علیه انسان به سمت الگوریتم علیه الگوریتم در حال تکامل است.

هوش مصنوعی به مثابه سپر دفاعی: تقویت استحکامات دیجیتال

هوش مصنوعی با توانایی پردازش و تحلیل حجم عظیمی از دادهها در لحظه، دفاع سایبری را به شکل چشمگیری تقویت میکند. این سیستمها با تحلیل دادههای تاریخی، یک “خط پایه” از رفتار نرمال برای هر کاربر و دستگاه در شبکه ایجاد کرده و هرگونه انحراف معنادار از آن را به عنوان یک ناهنجاری شناسایی میکنند. این قابلیت به ویژه برای شناسایی تهدیدات داخلی و حسابهای کاربری به سرقت رفته که فاقد امضای بدافزاری مشخص هستند، بسیار مؤثر است.

یکی از بزرگترین مزایای هوش مصنوعی، توانایی آن در شکار تهدیدات پیشرفته و حملات روز-صفر است. به جای جستجوی امضاهای شناختهشده، مدلهای یادگیری عمیق، ویژگیهای ذاتی و الگوهای رفتاری فایلها را تحلیل میکنند تا ماهیت مخرب آنها را تشخیص دهند. برای مثال، اگر برنامهای رفتاری شبیه به باجافزار (مانند رمزگذاری سریع فایلها) از خود نشان دهد، هوش مصنوعی آن را به عنوان تهدید شناسایی میکند، حتی اگر قبلاً هرگز دیده نشده باشد. این رویکرد نرخ تشخیص تهدیدات را از ۳۰-۶۰ درصد در سیستمهای سنتی به ۸۰-۹۲ درصد افزایش میدهد.

علاوه بر این، هوش مصنوعی فرآیندهای امنیتی را خودکار میکند. پلتفرمهای ارکستراسیون، اتوماسیون و پاسخ امنیتی (SOAR) که با هوش مصنوعی تقویت شدهاند، میتوانند به طور خودکار به تهدیدات شناساییشده پاسخ دهند؛ مثلاً با قطع دسترسی شبکهای یک دستگاه آلوده، از گسترش حمله جلوگیری میکنند. این اتوماسیون، زمان پاسخ به حوادث را از چند ساعت به چند ثانیه کاهش داده و با فیلتر کردن هشدارهای کاذب، به تحلیلگران انسانی اجازه میدهد تا بر روی تهدیدات پیچیدهتر تمرکز کنند.

هوش مصنوعی به مثابه سلاح تهاجمی: تکامل تهدیدات سایبری

همانطور که هوش مصنوعی دفاع را تقویت میکند، به ابزاری قدرتمند در دست مهاجمان نیز تبدیل شده است. مجرمان سایبری از هوش مصنوعی برای ساخت بدافزارهای هوشمند “چندریختی” و “دگرریختی” استفاده میکنند که با تغییر مداوم کد خود، از سیستمهای امنیتی مبتنی بر امضا فرار میکنند. نگرانکنندهتر، بدافزارهای خودکاری هستند که پس از نفوذ، به طور مستقل در شبکه حرکت کرده، از مکانیزمهای دفاعی میآموزند و تاکتیکهای خود را برای دور زدن آنها تطبیق میدهند.

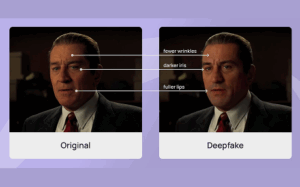

هوش مصنوعی مولد، حملات مهندسی اجتماعی را به سطح جدیدی از خطر رسانده است. مدلهای زبانی بزرگ میتوانند ایمیلهای فیشینگ بسیار قانعکننده و شخصیسازیشده را در مقیاس انبوه تولید کنند. خطرناکتر از آن، فناوری “دیپفیک” (Deepfake) است که به مهاجمان اجازه میدهد ویدئوها و صداهای جعلی بسیار واقعگرایانهای تولید کنند. از این فناوری میتوان برای کلاهبرداریهای صوتی (جعل صدای مدیرعامل برای دستور انتقال وجه)، انتشار اطلاعات نادرست، و دور زدن سیستمهای احراز هویت بیومتریک استفاده کرد.

پیچیدهترین کاربرد تهاجمی هوش مصنوعی، “حملات تخاصمی” است که مستقیماً خود سیستمهای دفاعی مبتنی بر هوش مصنوعی را هدف قرار میدهند. در “حملات گریز”، مهاجم یک فایل بدافزار را با ایجاد تغییرات جزئی به گونهای دستکاری میکند که توسط مدل هوش مصنوعی مدافع به اشتباه به عنوان یک فایل بیخطر طبقهبندی شود. در حملات “مسمومسازی دادهها”، مهاجم دادههای آموزشی مدل را دستکاری کرده و یک “درب پشتی” در آن ایجاد میکند تا مدل یاد بگیرد نوع خاصی از حملات را نادیده بگیرد. این تکنیکها، قابلیتهای پیشرفته حمله را “دموکراتیزه” کرده و به بازیگران کممهارت اجازه میدهند حملاتی را اجرا کنند که پیش از این تنها در انحصار گروههای بسیار ماهر بود.

چالشها، محدودیتها و ملاحظات استراتژیک

پیادهسازی موفق هوش مصنوعی در امنیت سایبری با چالشهای قابل توجهی همراه است. مدلهای هوش مصنوعی به حجم عظیمی از دادههای باکیفیت و بدون سوگیری نیاز دارند که جمعآوری و آمادهسازی آنها پرهزینه است. دادههای ناقص یا مغرضانه منجر به تصمیمگیریهای نادرست و ایجاد نقاط کور امنیتی میشود. همچنین، دسترسی به دادههای حساس برای تحلیل، نگرانیهای جدی در مورد حریم خصوصی ایجاد میکند.

بسیاری از مدلهای پیشرفته هوش مصنوعی مانند یک “جعبه سیاه” عمل میکنند؛ یعنی توضیح اینکه چرا و چگونه به یک تصمیم خاص رسیدهاند، بسیار دشوار است. این عدم شفافیت، اعتماد به سیستم را کاهش داده و فرآیندهای تحقیق و حسابرسی را پیچیده میکند. هزینههای بالای زیرساختهای محاسباتی و کمبود متخصصان ماهر در حوزه هوش مصنوعی نیز موانع بزرگی برای پیادهسازی این فناوری، به ویژه برای کسبوکارهای کوچک، محسوب میشوند. در نهایت، ابهامات حقوقی و اخلاقی، مانند تعیین مسئولیت در صورت خطای یک سیستم خودکار، چالشهای حاکمیتی پیچیدهای را به وجود آورده است که نیازمند راهکارهای جامع و چندرشتهای است.

نتیجهگیری: چشمانداز آینده و راهبردهای پیش رو

آینده امنیت سایبری تحتالشعاع یک رقابت تسلیحاتی بیپایان بین کاربردهای تهاجمی و دفاعی هوش مصنوعی قرار خواهد گرفت. در این چشمانداز پویا، راهبردها و ابزارهای ایستا به سرعت منسوخ خواهند شد. موفقیت در گرو یک مدل همکاری مؤثر بین انسان و ماشین (Human-Machine Teaming) است. هوش مصنوعی جایگزین متخصصان انسانی نخواهد شد، بلکه به عنوان یک شریک قدرتمند، وظایف تکراری را خودکار کرده و به انسانها اجازه میدهد تا بر روی تصمیمگیریهای راهبردی، نظارت و شکار تهدیدات پیچیده تمرکز کنند.

برای تابآوری در این محیط جدید، سازمانها باید راهبردهای چندوجهی اتخاذ کنند. سرمایهگذاری بر روی اصول بنیادین امنیت، اتخاذ رویکرد دفاع در عمق، و آموزش مستمر کارکنان برای مقابله با تهدیدات نوظهور مانند دیپفیک، از اهمیت بالایی برخوردار است. مسیر پیش رو، نه هراس از هوش مصنوعی، بلکه پذیرش راهبردی، متفکرانه و اخلاقی این فناوری است. موفقیت در عصر جدید امنیت سایبری به توانایی ما در ساختن اکوسیستمی بستگی دارد که در آن، هوش انسانی و هوش ماشینی در همکاری تنگاتنگ، قادر به مقابله با تهدیدات پویای آینده باشند.

سایر مطالب مرتبط:

دیپفیک (Deepfake) چیست و چگونه میتواند تهدیدی برای حقیقت باشد؟